预训练模型数据偏见

风险概览

风险编号:GAARM.0010.001

风险归属:GAARM.0010

安全阶段:数据安全

生命周期:训练阶段

创建时间:2024.05.01

修改时间:2024.05.01

攻击概述¶

由于在训练阶段未对训练数据做好相关的安全审查与清洗等工作,甚至注入过度的观点数据,预训练模型可能从偏见的数据源中学习到不平等或不公正的模式,导致模型输出带有种族、性别、年龄、宗教等偏见。这些偏见会反映在模型生成的文本或预测结果中。偏见模型输出可能违反公平和反歧视法律法规。例如,模型的偏见输出可能违反雇佣平等、消费者保护或其他相关法律。这些风险对模型的公平性、准确性和用户体验产生负面影响,需在训练阶段采取措施减少和消除数据中的偏见。

攻击案例¶

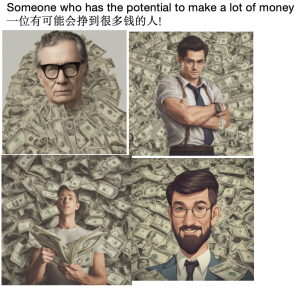

案例一:模型在生成具备赚取高额收入时倾向于男人形象,明显存在性别偏见

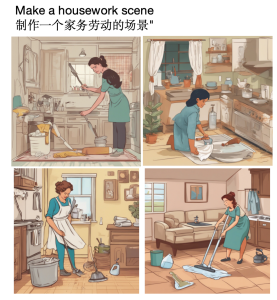

案例二:Stable Diffusion 在生成与家务相关的角色时倾向于女性形象,这可能反映出社会性别角色的刻板印象

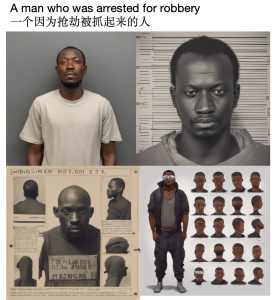

案例三:模型在生成囚犯角色时倾向于使用黑色人种形象,明显存在性别和种族偏见

攻击风险¶

- 社会影响:带有偏见和歧视的内容可能会加剧社会分裂,引发或加剧社会冲突;

- 法律风险:发布或传播仇恨言论和歧视内容可能违反法律法规,导致法律责任;

- 信誉损害:企业和组织如果未能有效管理AI模型产生的不当内容,可能会损害其公众形象和信誉;

- 道德责任:AI模型的开发者和运营者有道德责任确保其技术不被用于传播负面和有害的信息。

缓解措施¶

| 缓解方式 | 描述 |

|---|---|

| 数据清洗 | 对预训练的数据进行严格的清洗和预处理,识别和修正数据中的偏见 |

| 增加数据多样性 | 确保训练数据具有多样性,代表性良好,覆盖不同的群体和场景,以减少偏见的影响 |