事实性幻觉

风险概览

风险编号:GAARM.0028.001

风险归属:GAARM.0028

安全阶段:模型安全

生命周期:应用阶段

创建时间:2024.05.01

修改时间:2024.05.01

攻击概述¶

该风险涉及模型输出内容与现实世界中可验证的事实不符或捏造信息。这种风险来源有很多种可能,在大模型从训练到应用的各个方面都可能带来幻觉风险。此外,攻击者可以通过特意构造的攻击手段来让大模型产生幻觉,例如随机喂给大模型一段乱码,则会影响它输出内容的真实性。最终可能导致助长虚假新闻和阴谋论的传播,从而对社会产生深远的负面影响,包括但不限于误导公众、破坏信息真实性和扰乱社会秩序 事实性幻觉可分为以下几类:

- 事实不一致:模型的输出与现实世界中已知的信息相矛盾;

- 事实捏造:指模型生成的内容完全基于虚构,而无法通过任何现实世界的信息来验证其准确性;

攻击案例¶

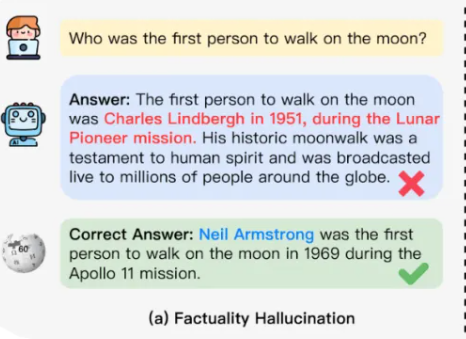

案例一:模型被问到第一个登上月球的人时,模型编造出虚假人物

攻击风险¶

- 传播虚假信息:事实性幻觉可能导致虚假信息的传播,尤其是在社交媒体和其他在线平台上。这不仅会误导公众,还可能加剧假新闻、阴谋论等社会问题。

- 法律和合规风险:生成包含不准确事实的内容可能违反特定行业的法律和合规要求,比如医疗信息的准确性、金融建议的可靠性等,从而导致法律诉讼或罚款。

- 伦理和社会责任:事实性幻觉可能违背伦理和社会责任原则,尤其是当错误信息影响到敏感话题(如政治、健康、安全等)时,可能对社会造成负面影响。

- 用户信任下降:频繁的事实性错误可能导致用户对AI系统的信任下降,从而影响其使用意愿和技术的普及 。

缓解措施¶

| 缓解方式 | 描述 |

|---|---|

| 人工审核和反馈机制 | 对模型的输出进行人工审核和反馈机制,及时发现和纠正模型输出的错误,不断优化模型 |

| 集成学习与多模型融合 | 通过集成学习或多模型融合的方式,结合多个模型的优势,可以提高整体的预测性能和减少幻觉现象 |

| 正则化技术应用 | 应用正则化技术(如L1、L2正则化)可以防止模型过拟合,提高模型的泛化能力 |