风险概览

风险编号:GAARM.0028.002

风险归属:GAARM.0028

安全阶段:模型安全

生命周期:应用阶段

创建时间:2024.05.01

修改时间:2024.05.01

攻击概述¶

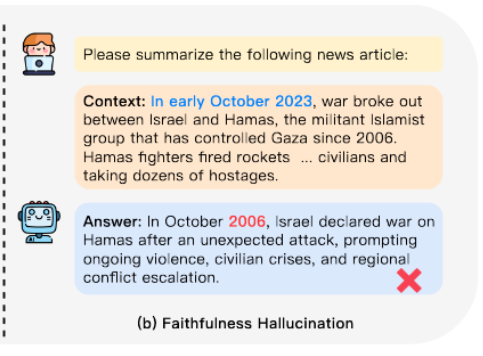

忠实幻觉性指的是生成的内容与用户所提供的指令或上下文信息之间存在不一致。有很多攻击手段可以让大模型产生忠实性幻觉。例如,通过对输入数据进行微小的扰动,使模型产生错误预测或生成虚假信息,影响大模型的逻辑;通过多次查询模型,推断其内部逻辑,进而设计输入使模型产生幻觉;利用生成对抗网络生成虚假的数据样本,诱使其他模型产生错误输出等。

忠实性幻觉分为以下三种类型:

- 指令不一致:LLM忽略了用户提供的具体指令。例如,按照指示将一个问题翻译成西班牙语,但模型却以英语提供了答案;

- 上下文不一致:模型输出的内容包含了未在提供的上下文中出现或与之相矛盾的信息。例如,LLM声称尼罗河起源于山脉,而不是用户输入中提到的大湖地区;

- 逻辑不一致:模型的输出包含了逻辑错误,尽管开始时是正确的。例如,在一道分步数学解题中,LLM可能会在执行算术运算时出现错误,尽管开始时是正确的;

攻击案例¶

案例一:模型总结新闻文章,该模型错误地生成实际事件日期

| 案例 | 描述 |

|---|---|

| 案例二 | LLM在实现检测TCP SYN扫描软件时输出了错误的代码 |

攻击风险¶

- 用户决策误导:模型的输出与原始内容不一致,可能会误导用户,尤其是当用户依赖AI系统提供的信息进行决策时。

- 用户满意度下降:当用户发现生成的内容与其请求不匹配或逻辑上存在明显错误时,可能会感到困惑或失望,这会直接影响到用户对系统的满意度和信任度。

- **自动化流程出错:**在自动化流程中,忠实性幻觉可能导致自动化流程出错或中断,需要人工介入纠正,从而降低整体效率和产出。

缓解措施¶

| 缓解方式 | 描述 |

|---|---|

| 人工审核和反馈机制 | 对模型的输出进行人工审核和反馈机制,及时发现和纠正模型输出的错误,不断优化模型 |

| 集成学习与多模型融合 | 通过集成学习或多模型融合的方式,结合多个模型的优势,可以提高整体的预测性能和减少幻觉现象 |

| 正则化技术应用 | 应用正则化技术(如L1、L2正则化)可以防止模型过拟合,提高模型的泛化能力 |